Théorie de la détection du signal

La théorie de la détection du signal est une application de la théorie de la décision concernant la détection d'une information ou d'un motif dans un signal mesuré en présence de bruit. Cette théorie décrit comment choisir de manière optimale un critère permettant de discerner l'information jugée utile - le signal - du bruit environnant, en tenant compte de la nature probabiliste de la source du signal, des différentes sources de bruit et du récepteur, à savoir l'outil de mesure du signal. Elle définit en outre des critères de qualité de la détection obtenue et plus généralement de la performance du récepteur.

Les débuts de la théorie de la détection du signal remontent au développement des récepteurs radar.

Les principales applications de cette théorie sont, outre le radar, les télécommunications, le contrôle qualité, et l'astronomie d'observation.

Cas de la détection binaire

C'est le cas le plus simple, dans lequel on cherche à différencier deux états possibles, généralement la présence ou l'absence d'une information dans un ou plusieurs signaux déterministes en présence de bruit aléatoire. Cela revient aussi à un problème de classification automatique supervisée dans le cas où il y a deux classes. On considère un ensemble de n signaux pouvant être émis aléatoirement par l'une de deux sources H1 et H2, avec des probabilités p1 et p2 (telles que ), appelées probabilités a priori. Ceci produit une variable aléatoire continue X sur un espace d'observation dont les probabilités conditionnelles sont définies par les fonctions densité de probabilité fX|H1 et fX|H2.

On cherche une partition de l'espace d'observation telle que . Etant donnée une réalisation x de X, c'est-à-dire une mesure du signal, on lui associe les décisions :

- D1 si x est dans

- D2 si x est dans

Il y a donc quatre types d'événement possibles :

- Décision D1 sous l'hypothèse H1, appelé vrai négatif

- Décision D1 sous l'hypothèse H2, appelé faux négatif

- Décision D2 sous l'hypothèse H1, appelé faux positif

- Décision D2 sous l'hypothèse H2, appelé vrai positif

auxquels sont associés les probabilités conditionnelles .

La règle de décision se base sur le rapport de vraisemblance et une valeur de seuil tels que

et

.

Cette règle permet d'exprimer les probabilités conditionnelles de décision en fonction du rapport de vraisemblance :

avec la fonction densité de probabilité associée à la probabilité conditionnelle de la variable aléatoire sous hypothèse Hj.

La performance de la détection est quantitifée au moyen :

- des probabilités totales de bonne ou mauvaise détection et , qui dépendent du niveau de seuil choisi,

- de la caractéristique opérationnelle du récepteur représentant graphiquement l'évolution du taux de vrai positifs et du taux de faux positifs en fonction du seuil .

Critère de Bayes

Toutes les décisions ne sont pas équivalentes quant à leur utilité. On associe donc un coût à chaque événement correspondant à la décision Di sous hypothèse Hj. En général les mauvaises décisions sont plus coûteuses et on a et . On cherche ensuite le niveau de seuil qui minimise le coût moyen

.

Celui ci est obtenu pour

c'est le seuil obtenu selon le critère de Bayes.

Le coût moyen se développe en

et puisque par définition , on a

Les deux premiers termes sont constants, tandis que les deux derniers termes dépendent de la partition choisie et par suite du niveau de seuil, car . On peut alors écrire

avec

Minimiser C revient à choisir la partition qui rend le terme sous l'intégrale négatif, c'est-à-dire et et

et donc

On retrouve à gauche de cette inégalité le rapport de vraisemblance et donc à droite le niveau de seuil obtenu en minimisant C.Maximum a posteriori

Si on choisit de pénaliser uniquement et uniformément les mauvaises détections et , le coût moyen devient . Ce choix particulier revient à minimiser la probabilité totale de mauvaise détection. Le niveau de seuil devient alors

On peut montrer que dans ce cas la règle de décision peut se reformuler sous la forme suivante :

étant la probabilité conditionnelle a posteriori de l'hypothèse Hj.

Cette règle revient donc à choisir à chaque fois le maximum de la probabilité a posteriori[1].

La règle de décision portant sur le rapport de vraisemblance s'écrit conduit à choisir D2, soit encore (et l'autre inégalité conduit à la décision H1). Par ailleurs, la probabilité conditionnelle a posteriori de l'hypothèse Hj étant donné X est définie par , avec la fonction densité de probabilité de la variable aléatoire X. Celle-ci se simplifie dans le rapport de vraisemblance, ce qui laisse apparaître le rapport des probabilités a posteriori

Critère minimax

Le critère de Bayes suppose la connaissance des probabilités a priori, ce qui n'est pas toujours le cas. On va donc essayer de se placer dans le pire cas du critère de Bayes, c'est-à-dire rechercher une des probabilités a priori, par exemple , de sorte à avoir

étant le coût moyen précédemment défini.

La valeur de seuil reste celle définie par le critère de Bayes

et la probabilité qui maximise le coût est solution de l'équation caractéristique

Les deux probabilités conditionnelles dépendent implicitement de au travers de .

Sachant que par définition des probabilités et , et en introduisant temporairement la notation , la fonction coût moyen du critère de Bayes se réécrit en

La fonction coût ainsi formulée dépend explicitement de deux variables, la probabilité a priori et le seuil .

La probabilité étant inconnue, on peut étudier les différents cas qui peuvent exister si l'on se donne arbitrairement une valeur pour définir le seuil par le critère de Bayes défini plus haut. Le niveau de seuil étant fixé, le coût moyen réel ne dépend plus que linéairement de la probabilité .

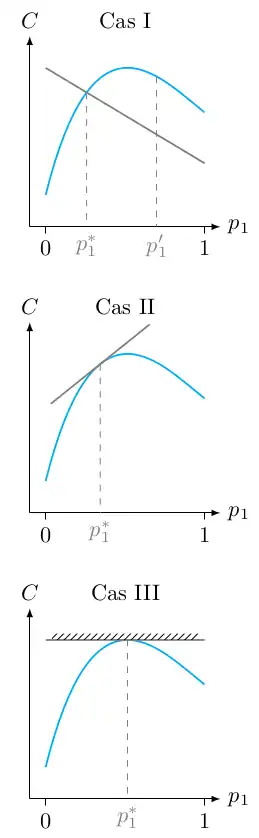

Dans le cas I, représenté sur la figure, la courbe bleue représente le coût moyen déduit du critère de Bayes en ce point et la droite en gris représente le coût moyen réél . En fait ce cas est interdit car pour une valeur le coût réél serait inférieur au coût donné par le critère de Bayes, ce qui est impossible car ce critère fournit le coût minimum pour une valeur de connue.

Donc, seul le cas II représenté sur la figure est possible : la droite du coût moyen réél est tangente en tout point à la courbe bleue. De plus celle-ci est nécessairement concave au sens de l'analyse. Toute partie convexe est interdite car elle permettrait de trouver une valeur du coût inférieur à celui donné par le critère de Bayes.

Finalement, dans le cas III de la figure, lorsque est choisi de sorte à satisfaire le maximum de , le coût moyen réel est une tangente horizontale en ce point, et par suite ce point est le seul à pouvoir majorer le coût moyen réél quel que soit .

De plus, la pente de la droite tangente est obtenue en dérivant partiellement par rapport à , et l'équation caractéristique est obtenue en annulant cette expression de la pente :

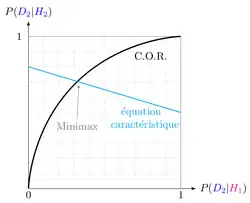

On peut représenter graphiquement le critère minimax en remarquant que puisque l'équation caractéristique est aussi l'équation d'une droite dans le plan . Son intersection avec la courbe caractéristique opérationnelle du récepteur donne directement les probabilités conditionnelles satisfaisant le critère minimax.

Critère de Neyman-Pearson

Les critères précédents supposent tous qu'il est possible de définir le coût associé aux différentes décisions. Toutefois lorsque ceci n'est pas possible, il existe une autre approche consistant à fixer a priori le taux de faux positif à une valeur et à rendre maximum le taux de bonne détection .

Ceci revient à chercher un niveau de seuil intervenant dans la règle de décision

tel que

Il faut démontrer que le choix ci-dessus du seuil est en fait optimal, c'est-à-dire qu'il maximise le taux de bonne détection .

On recherche donc une partition de l'espace d'observation qui maximise

étant un multiplicateur de Lagrange. De par la définition des probabilités conditionnelles en terme de densité de probabilité conditionnelles , la fonction coût ci-dessous peut encore s'exprimer sous la forme

Maximiser J revient à rendre l'intégrande positif si x est dans et négatif lorsque x est dans :

conduit à la décision D2

et

conduit à la décision D1

En faisant apparaître le rapport de vraisemblance, on voit que le multiplicateur de Lagrange est exactement le seuil optimal recherché.On peut interpréter graphiquement le critère de Neyman-Pearson à l'aide de la courbe caractéristique opérationnelle du récepteur. Le taux de faux positif en abscisse est directement donné par le niveau désiré . D'autre part, une propriété de la caractéristique opérationnelle du récepteur est que sa pente est égale au niveau de seuil . Le critère de Neyman-Pearson revient donc à mesurer la pente de la courbe au point d'abscisse considéré.

Application au cas d'un signal en présence de bruit gaussien

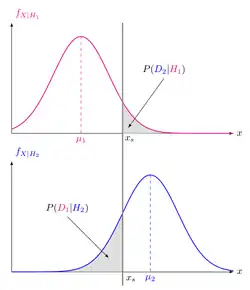

On se place dans le cas où une seule mesure (n = 1) est produite par deux hypothèses

- H1 : la variable aléatoire X est distribuée suivant une loi normale d'espérance mathématique et de variance ,

- H2 : la variable aléatoire X est distribuée suivant une loi normale d'espérance (que l'on suppose plus grande que ) et de même variance .

Autrement dit, le signal peut prendre deux valeurs déterministes et auxquelles un bruit gaussien est ajouté.

Le critère du maximum a posteriori fournit la règle de décision suivante sur la valeur mesurée x :

avec une valeur de seuil

Les probabilités conditionnelles sont données ici par :

dans lesquelles est la fonction de répartition de la loi normale centrée réduite, soit encore , erf étant la fonction d'erreur.

La probabilité totale de mauvaise détection résultant de ce choix est donc

Une autre facçon d'évaluer la détection est de tracer la courbe de la caractéristique opérationnelle du récepteur, c'est-à-dire en fonction de lorsqu'on fait varier de à .

Notes et références

- ↑ Bernard Dubuisson, Cours de théorie statistique de la décision pour le diplôme d'études approfondies en contrôle des systèmes : Détection et estimation, Université de Technologie de Compiègne,

Voir aussi

Articles connexes

Bibliographie

- (en) Peter Bajorski, Statistics for Imaging, Optics and Photonics, Wiley, (ISBN 978-0-470-50945-6)

- (en) Mourad Barkat, Signal Detection and Estimation, Artech House, (ISBN 0-89006-454-7)

- Portail des probabilités et de la statistique